Los resultados del estudio pueden ser muy útiles para las aplicaciones de aprendizaje automático que necesitan una inferencia rápida y precisa en los dispositivos finales.

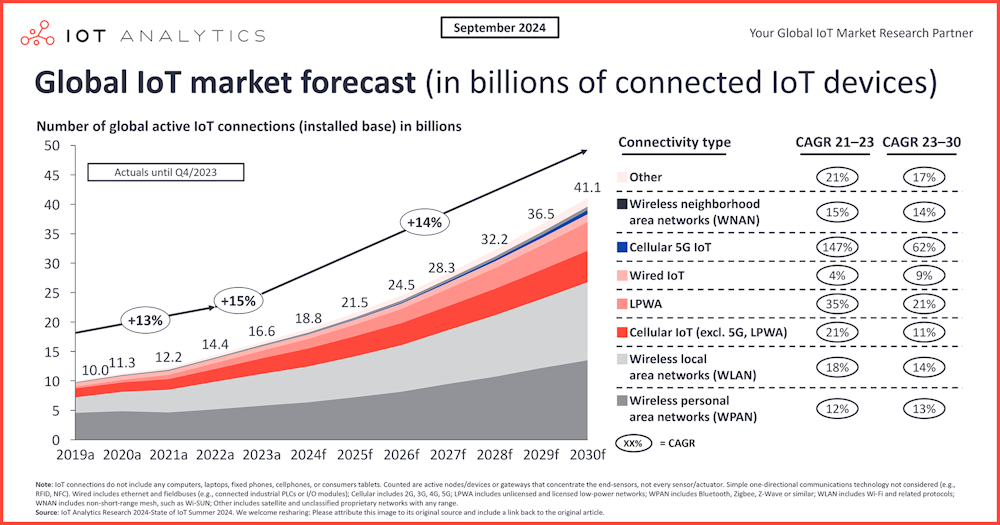

Estamos en una era fascinante en la que incluso los dispositivos de bajos recursos, como los sensores del Internet de las Cosas (IoT), pueden utilizar algoritmos de aprendizaje profundo para abordar problemas complejos como la clasificación de imágenes o el procesamiento del lenguaje natural (la rama de la inteligencia artificial que se ocupa de dar a los ordenadores la capacidad de entender el lenguaje hablado y escrito de la misma manera que los humanos). Sin embargo, el aprendizaje profundo en los sensores del IoT puede no ser capaz de garantizar los requisitos de calidad de servicio (QoS), como la precisión de la inferencia y la latencia. Con el crecimiento exponencial de los datos recogidos por miles de millones de dispositivos IoT, ha surgido la necesidad de cambiar a un modelo distribuido en el que parte de la computación se produce en el borde de la red (edge computing), más cerca de donde se crean los datos, en lugar de enviarlos a la nube para su procesamiento y almacenamiento.

Los investigadores de IMDEA Networks Andrea Fresa (estudiante de doctorado) y Jaya Prakash Champati (profesor asistente de investigación) han realizado un estudio en el que han presentado el algoritmo AMR², que hace uso de la infraestructura de computación de borde (procesando, analizando y almacenando los datos más cerca de donde se generan para permitir un análisis y unas respuestas más rápidas y casi en tiempo real) para aumentar la precisión de la inferencia de los sensores de IoT, respetando al mismo tiempo las restricciones de latencia, y han demostrado que el problema está resuelto. El artículo "An Offloading Algorithm for Maximizing Inference Accuracy on Edge Device in an Edge Intelligence System" ha sido publicado esta semana en la conferencia MSWiM.

Para entender qué es la inferencia, hay que explicar primero que el aprendizaje automático funciona en dos fases principales. La primera se refiere al entrenamiento, cuando el desarrollador alimenta su modelo con un conjunto de datos curados para que pueda "aprender" todo lo que necesita saber sobre el tipo de datos que va a analizar. La siguiente fase es la inferencia: el modelo puede hacer predicciones basadas en datos reales para producir resultados procesables.

En su publicación, los investigadores han llegado a la conclusión de que la precisión de la inferencia aumentó hasta un 40% al comparar el algoritmo AMR² con las técnicas básicas de programación. También han descubierto que un algoritmo de programación eficiente es esencial para apoyar adecuadamente los algoritmos de aprendizaje automático en el borde de la red.

"Los resultados de nuestro estudio podrían ser extremadamente útiles para las aplicaciones de aprendizaje automático (ML) que necesitan una inferencia rápida y precisa en los dispositivos finales. Pensemos en un servicio como Google Photos, por ejemplo, que categoriza elementos de imágenes. Podemos garantizar el retardo de ejecución utilizando el algoritmo AMR², lo que puede ser muy fructífero para un desarrollador que puede utilizarlo en el diseño para garantizar que los retrasos no sean visibles para el usuario", explica Andrea Fresa.

El principal obstáculo que han encontrado para llevar a cabo este estudio es demostrar el rendimiento teórico del algoritmo AMR² y validarlo utilizando un banco de pruebas experimental compuesto por una Raspberry Pi y un servidor conectados a través de una LAN. "Para demostrar los límites de rendimiento de AMR², hemos empleado ideas fundamentales de la programación lineal y herramientas de la investigación operativa", destaca Fresa.

Sin embargo, con este trabajo, los investigadores de IMDEA Networks han sentado las bases para futuras investigaciones que permitirán ejecutar aplicaciones de aprendizaje automático (ML) en el borde de la red de forma rápida y precisa.

(Imdea)